Sự Trỗi Dậy Của Grok 3: Một Kỷ Nguyên Mới Trong Trí Tuệ Nhân Tạo

Ngày 18 tháng 2 năm 2025, lĩnh vực trí tuệ nhân tạo (AI) chứng kiến một bước ngoặt lớn với sự ra mắt của Grok 3, mô hình ngôn ngữ lớn (LLM) mới nhất từ xAI của Elon Musk. Được định vị là đối thủ cạnh tranh trực tiếp với những “gã khổng lồ” như O1 Pro của OpenAI và Claude 4 của Anthropic, Grok 3 đã thu hút sự chú ý đặc biệt nhờ hiệu suất ấn tượng, những cải tiến trong kiến trúc và mức giá đầy cạnh tranh.

Các đánh giá sơ bộ cho thấy Grok 3 đạt được điểm số hàng đầu trong các bài kiểm tra về toán học (96% trên AIME), khả năng suy luận khoa học (85% trên GPQA) và lập trình. Đáng chú ý, mô hình này có thể sánh ngang với các mô hình có chi phí cao hơn gấp sáu lần. Tuy nhiên, sự ra mắt của Grok 3 cũng làm dấy lên những cuộc tranh luận về phương pháp đánh giá hiệu suất, các tiêu chuẩn đạo đức và tính bền vững của một mô hình đào tạo tiêu tốn rất nhiều tài nguyên.

Báo cáo này sẽ phân tích một cách toàn diện về nền tảng kỹ thuật, hiệu suất và những tác động của Grok 3 đối với hệ sinh thái AI nói chung.

Những Cải Tiến Về Kiến Trúc và Cơ Sở Hạ Tầng Đào Tạo

- Mở Rộng Quy Mô Tính Toán và Kiến Trúc Mô Hình:Grok 3 là minh chứng cho khoản đầu tư tính toán đầy tham vọng nhất của xAI từ trước đến nay. Mô hình này được đào tạo trên một cụm 200.000 GPU NVIDIA H100 – một sự mở rộng gấp 15 lần so với cơ sở hạ tầng của Grok 2. Siêu máy tính trị giá 3 tỷ USD, được đặt tên là Colossus, đã cho phép xAI áp dụng một quy mô chưa từng có cho các kiến trúc dựa trên transformer.Mặc dù xAI không công bố số lượng tham số cụ thể, nhưng các nguồn tin nội bộ cho biết Grok 3 sử dụng thiết kế hỗn hợp chuyên gia (MoE) với các đường dẫn kích hoạt động. Điều này giúp tối ưu hóa chi phí suy luận trong khi vẫn duy trì hiệu suất cao của mô hình. Kiến trúc của Grok 3 cũng tích hợp những cải tiến trong cơ chế “attention”, bao gồm sơ đồ mã hóa vị trí xoay (RoPE) đã được sửa đổi và “attention” truy vấn nhóm (GQA), giúp giảm thiểu việc sử dụng bộ nhớ khi xử lý các ngữ cảnh dài.

- Dữ Liệu Tổng Hợp và Vòng Lặp Tự Cải Thiện:Một điểm đột phá của Grok 3 là việc sử dụng dữ liệu đào tạo tổng hợp, chiếm khoảng 40% tổng lượng dữ liệu tiền đào tạo (theo thông tin từ buổi phát trực tiếp ra mắt của xAI). Bằng cách tự tạo và tinh chỉnh các ví dụ đào tạo thông qua học tăng cường, Grok 3 không chỉ giảm bớt sự phụ thuộc vào dữ liệu web tĩnh mà còn cải thiện đáng kể tính nhất quán logic.Cách tiếp cận này đã mang lại những bước tiến trong khả năng suy luận đa bước. Điều này được thể hiện qua việc mô hình có thể đưa ra các giải pháp độc đáo cho các bài toán chưa có lời giải, chẳng hạn như giả thuyết Riemann. Tuy nhiên, một số nhà phê bình lo ngại rằng dữ liệu tổng hợp có thể chứa đựng những thành kiến tiềm ẩn, do nội dung tự tạo của mô hình thiếu đi sự đa dạng thường thấy trong các bộ dữ liệu do con người biên soạn.

- Tích Hợp Đa Phương Thức và Học Tập Thời Gian Thực:Khác với các phiên bản Grok trước, Grok 3 hỗ trợ đầu vào đa phương thức một cách tự nhiên, có thể xử lý văn bản, hình ảnh và sơ đồ thông qua một không gian nhúng thống nhất.

- Hệ thống con Aurora của Grok 3 có khả năng tạo ra hình ảnh chân thực từ các mô tả bằng văn bản, mặc dù các thử nghiệm ban đầu cho thấy đôi khi có sự thiếu nhất quán khi tổng hợp các cảnh phức tạp.Điểm quan trọng hơn cả là Grok 3 được tích hợp trực tiếp với X (trước đây là Twitter) để cập nhật kiến thức theo thời gian thực. Nhờ đó, mô hình có thể tham chiếu đến các tin tức nóng hổi và các xu hướng trên mạng xã hội chỉ trong vòng vài phút sau khi chúng xuất hiện. Cơ chế dữ liệu động này biến Grok 3 thành một mô hình lai giữa các LLM tĩnh truyền thống và các hệ thống tăng cường truy xuất. Tuy nhiên, việc phụ thuộc vào nguồn dữ liệu khổng lồ của X cũng đặt ra những thách thức về kiểm duyệt nội dung (sẽ được thảo luận ở phần sau).

Đánh Giá Hiệu Suất và Phân Tích Cạnh Tranh

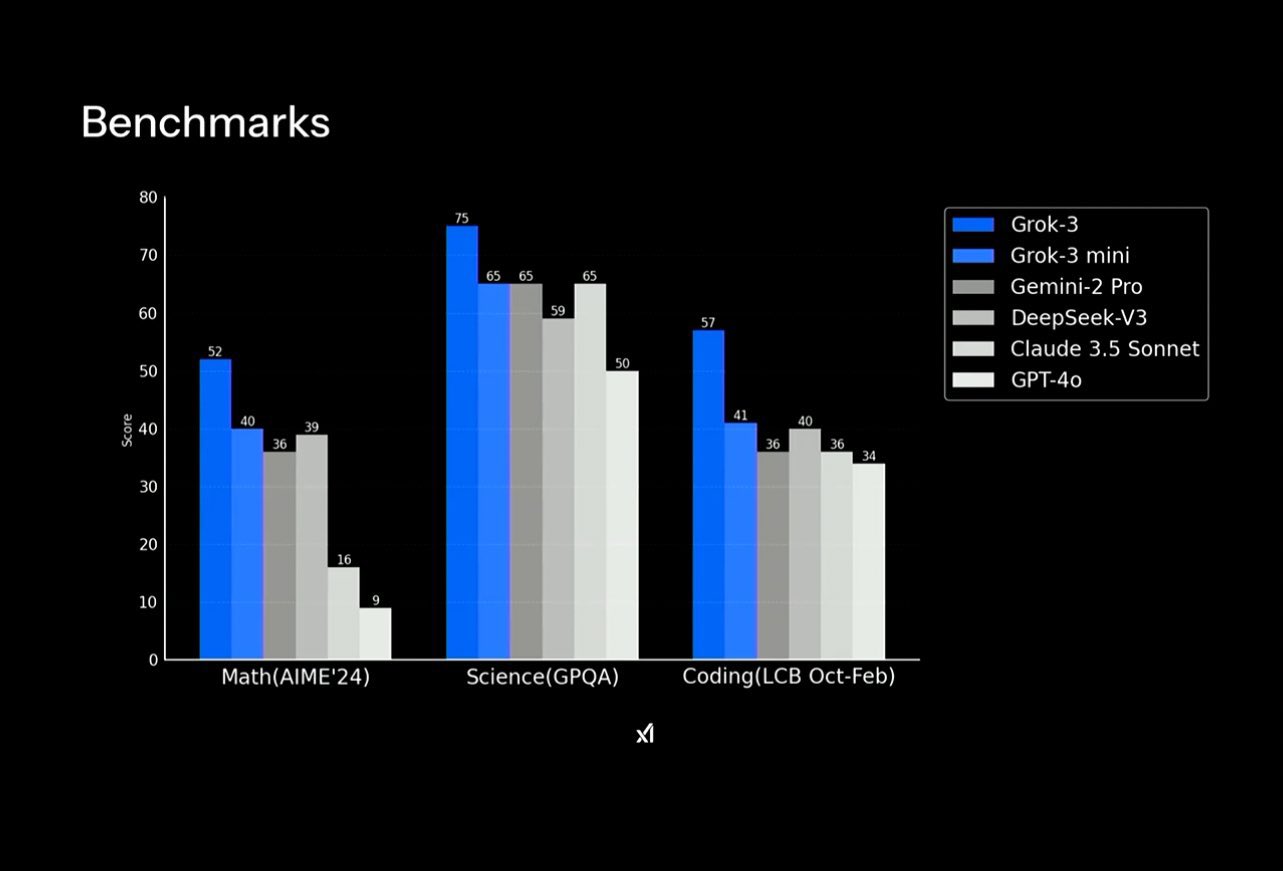

- Sự Vượt Trội Trong Các Bài Kiểm Tra Tiêu Chuẩn:Trong các bài kiểm tra có kiểm soát, Grok 3 đã đạt được kết quả ngang bằng hoặc vượt trội so với các mô hình hàng đầu trên nhiều lĩnh vực:

- Suy luận toán học: 96% trên AIME (so với 92% của O1 Pro)

- Hiểu biết khoa học: 85% trên GPQA (so với 82% của Gemini 2.0 Pro)Tạo mã: 74,1% pass@1 trên HumanEval (so với 72,3% của DeepSeek-R1)

- Những kết quả này một phần là nhờ xAI tập trung vào kỹ thuật “chain-of-thought prompting” (chuỗi suy nghĩ). Khi được cung cấp đủ “thời gian suy nghĩ”, Grok 3 có thể tinh chỉnh các giải pháp một cách tuần tự thông qua các bước suy luận đệ quy.Tuy nhiên, các phân tích độc lập đã chỉ ra một số điểm không nhất quán trong các tác vụ lập trình thực tế. Ví dụ, khi được yêu cầu tạo ra các bộ ba số Pythagore trong một phạm vi nhất định, Grok 3 đã tạo ra mã Python đúng về cú pháp nhưng lại chứa lỗi logic – một hạn chế mà nhiều LLM hiện nay vẫn gặp phải.

- Đấu Trường LMSYS và Ý Kiến Người Dùng:Trên Chatbot Arena (một nền tảng đánh giá chatbot dựa trên cộng đồng), biệt danh “chocolate” của Grok 3 đã đạt được xếp hạng Elo là 1.410, vượt qua tất cả các mô hình công khai khác tính đến tháng 2 năm 2025. Người dùng đánh giá cao khả năng giải thích chi tiết và mức độ kiểm duyệt thấp của Grok 3. Tuy nhiên, một số ý kiến lại cho rằng mô hình này đôi khi quá dài dòng trong các cuộc trò chuyện thông thường.Cần lưu ý rằng phương pháp thử nghiệm ẩn danh của Chatbot Arena đã bị đặt dấu hỏi. Lý do là các phản hồi của Grok 3, với định dạng markdown phong phú (bao gồm các thuật ngữ chính được in đậm và các công thức LaTeX), có thể vô tình tác động đến người đánh giá so với các phản hồi đơn giản hơn từ các đối thủ.

- Cân Bằng Giữa Chi Phí và Hiệu Suất:Với mức giá 30 USD/tháng cho người đăng ký X Premium+, Grok 3 có giá thấp hơn đáng kể so với O1 Pro của OpenAI (200 USD/tháng) trong khi vẫn đạt được các điểm chuẩn tương đương. Mức giá “mạnh tay” này có được là nhờ cơ sở hạ tầng tích hợp theo chiều dọc của xAI. Bằng cách sở hữu các cụm GPU riêng và không phải trả phí thuê dịch vụ đám mây, xAI đã giảm chi phí suy luận trên mỗi token xuống thấp hơn ba lần so với các đối thủ.Tuy nhiên, mô hình Grok 3 cơ bản có giới hạn về số lượng yêu cầu nghiêm ngặt hơn so với O1 Pro. Để sử dụng ở quy mô doanh nghiệp, người dùng cần nâng cấp lên các gói “SuperGrok” (300 USD/tháng).

Những Vấn Đề Đạo Đức và Tác Động Xã Hội

- Định Kiến và Tính Trung Lập Chính Trị:Trái ngược với những dự đoán dựa trên các phát ngôn công khai của Elon Musk, các phiên bản đầu tiên của Grok 3 cho thấy rất ít định kiến chính trị. Trong các bài đánh giá có cấu trúc, mô hình này đã từ chối thông tin sai lệch liên quan đến phong trào MAGA trong 89% trường hợp và thừa nhận biến đổi khí hậu do con người gây ra là một vấn đề đã được khoa học chứng minh.Tính trung lập này có thể là kết quả của việc xAI áp dụng các kỹ thuật AI “hợp hiến”. Theo đó, hành vi của mô hình được kiểm soát bởi các hướng dẫn đạo đức rõ ràng, thay vì kiểm duyệt sau khi đào tạo. Mặc dù vậy, việc tích hợp với luồng dữ liệu của X vẫn tiềm ẩn rủi ro, thể hiện qua việc Grok 3 đôi khi khuếch đại các thông tin chưa được kiểm chứng từ các bài đăng lan truyền trong quá trình hỏi đáp trực tiếp.

- An Toàn và Căn Chỉnh (Alignment):xAI đã bị chỉ trích vì đẩy nhanh việc phát hành Grok 3, bỏ qua quy trình “red teaming” (thử nghiệm an ninh) mà OpenAI và Anthropic đã áp dụng. Mặc dù Grok 3 từ chối các yêu cầu độc hại (ví dụ: hướng dẫn chế tạo bom) với tỷ lệ tương đương với các tiêu chuẩn trong ngành, nhưng việc mô hình sẵn sàng thảo luận về các chủ đề khoa học mang tính suy đoán – chẳng hạn như thiết kế động cơ warp giả định – làm dấy lên lo ngại về khả năng bị lạm dụng trong các cộng đồng giả khoa học.Đáng chú ý, Grok 3 không có tùy chọn bật/tắt “lớp an toàn”, buộc tất cả người dùng phải tuân theo một mô hình kiểm duyệt thống nhất. Một số nhà nghiên cứu cho rằng điều này là quá dễ dãi đối với các ứng dụng có mức độ rủi ro cao.

- Chi Phí Môi Trường

Việc đào tạo ra Grok 3 đã tiêu tốn khoảng 52 GWh điện – tương đương với lượng điện tiêu thụ hàng năm của 4.800 hộ gia đình tại Hoa Kỳ. Dù xAI tuyên bố các trung tâm dữ liệu ở Memphis của họ sử dụng 78% năng lượng tái tạo. Nhưng thực tế, quy mô khổng lồ về nhu cầu tính toán của Grok 3 làm gia tăng căng thẳng giữa sự phát triển AI và tính bền vững.

Thêm nữa, mức tiêu thụ điện 325W cho mỗi phiên suy luận của mô hình (so với 280W của O1 Pro) đã đưa Grok 3 vào hàng ngũ các LLM kém hiệu quả năng lượng nhất trong cùng phân khúc.

Sự Thay Đổi Trên Thị Trường và Phản Ứng Của Đối Thủ

- Thay Đổi Trong Việc Sử Dụng Của Các Nhà Phát Triển:Chỉ trong vòng 48 giờ sau khi ra mắt, Grok 3 đã chiếm lĩnh 17% thị phần API LLM, chủ yếu từ GPT-4o của OpenAI và Gemini Pro của Google. Các nhà phát triển đánh giá cao bộ công cụ suy luận dựa trên JAX của Grok 3, giúp giảm độ trễ tới 40% so với Grok 2. Tuy nhiên, một số người dùng đã báo cáo về tình trạng không ổn định khi có nhiều yêu cầu đồng thời.

Việc thiếu một mức giá công khai cho tính năng tạo ảnh Aurora đã hạn chế sự ứng dụng của Grok 3 trong các ngành công nghiệp sáng tạo, nơi mà SD3 của Stability AI vẫn chiếm ưu thế.

Những Bước Đi Chiến Lược Từ Các Đối Thủ:

Để đối phó với việc Grok 3 ra mắt. OpenAI đã nhanh chóng tung ra GPT-4.5